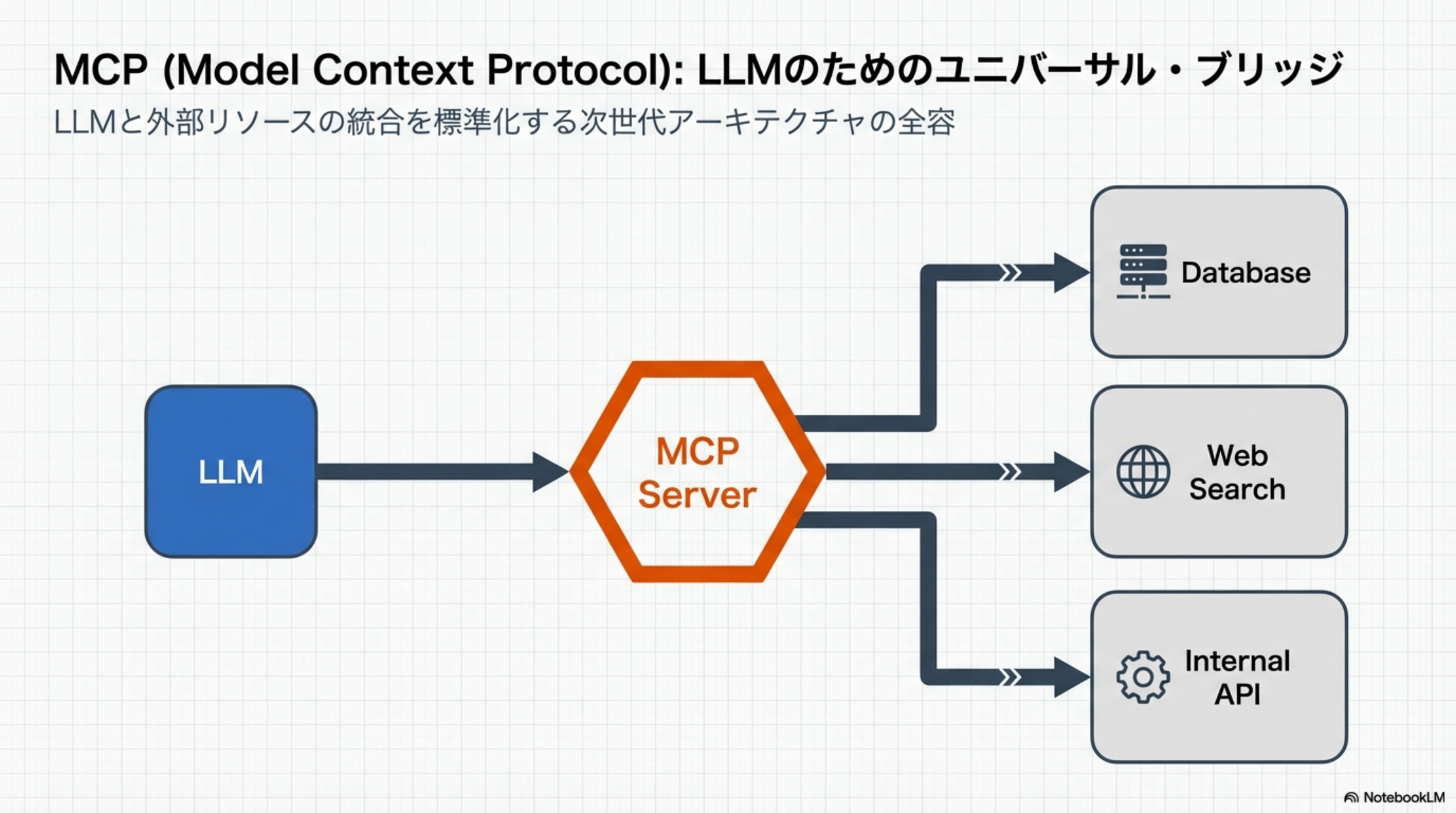

AI(LLM)が本当に「賢いアシスタント」として活躍するためには、外の世界にあるデータベース、Web API、社内システムなどの外部ツールと連携する必要があります。しかし、ツールごとにバラバラな接続方法を用意するのは、とても大変です。

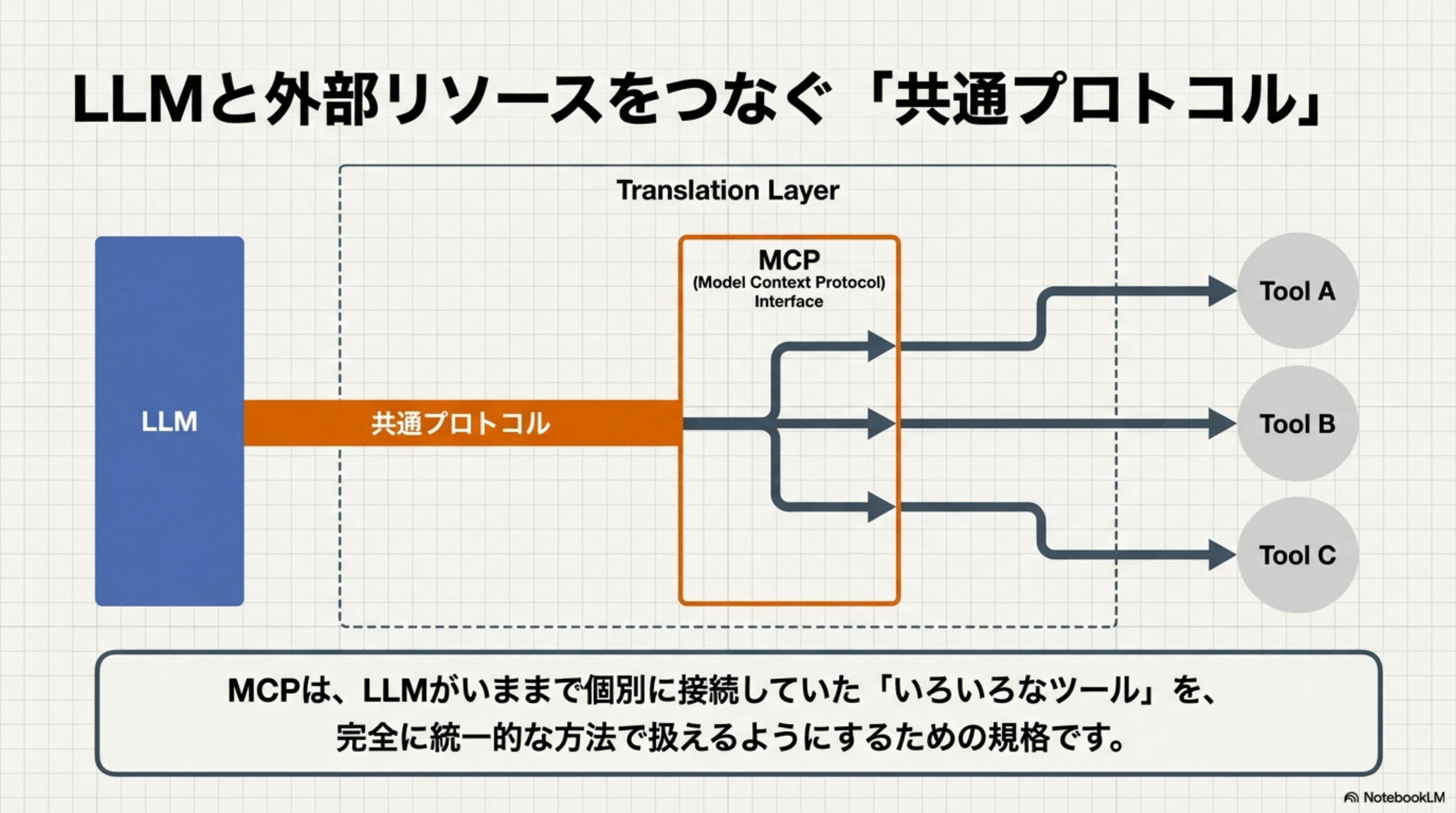

そこで登場したのが MCP(Model Context Protocol) です。MCPは、LLMが「いろいろなツール」を完全に統一的な方法で扱えるようにするための規格(プロトコル)です。

MCPは「万能翻訳機」のようなものです。あなたが海外旅行に行くとき、行く国ごとに別々の通訳を雇うのは大変ですよね? MCPは一人で何か国語も話せる通訳者。LLMがどんなツールと話したいときも、MCPが間に入って翻訳してくれます。

MCPとは何か? -- LLMと外部リソースをつなぐ「共通プロトコル」

従来のAIシステムでは、LLMがデータベースにアクセスしたい場合はデータベース専用のコネクタ、Web検索をしたい場合はWeb検索専用のコネクタ、社内APIを使いたい場合はAPI専用のコネクタ...と、ツールの数だけ個別の接続コードを書く必要がありました。

MCPはこの問題を解決します。LLMからの全てのリクエストを一つの標準化されたインターフェースで受け取り、適切なツールに振り分けてくれる「共通プロトコル」です。

- ツールごとに個別のコードを書く必要がなくなる

- 新しいツールを追加するとき、MCPの設定を追加するだけでOK

- LLMの種類を変えても、MCPの設定はそのまま使える

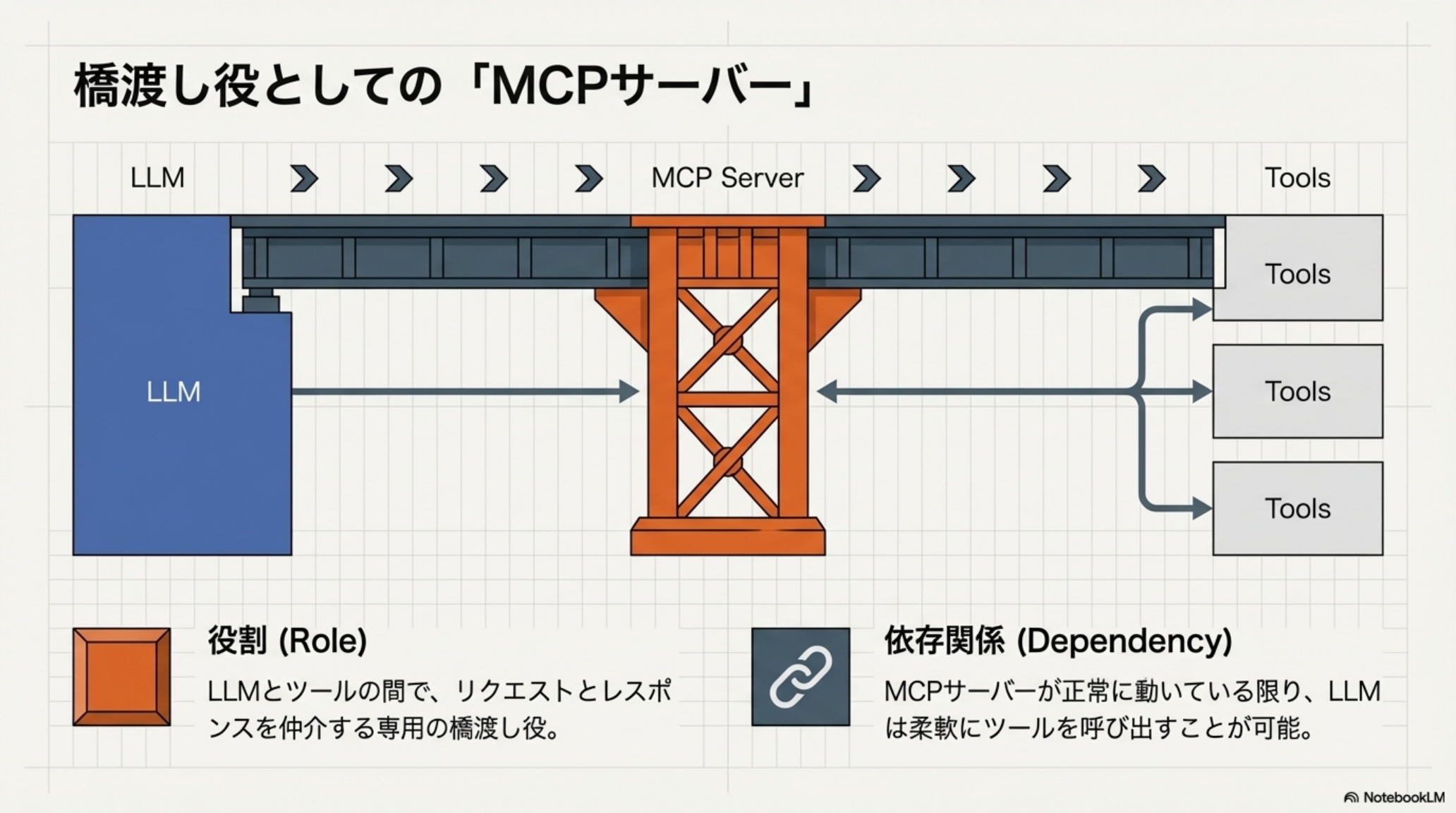

橋渡し役としての「MCPサーバー」

MCPサーバーは、LLMとツールの間に立つ「橋」のような存在です。LLMからのリクエストを受け取り、適切なツールに渡し、結果をLLMに返します。

役割(Role)

LLMとツールの間で、リクエストとレスポンスを仲介する専用の橋渡し役。LLMは直接ツールを呼ばず、必ずMCPサーバーを経由します。

依存関係(Dependency)

MCPサーバーが正常に動いている限り、LLMは柔軟にツールを呼び出すことが可能。逆に言えば、MCPサーバーが止まるとツールは使えなくなります。

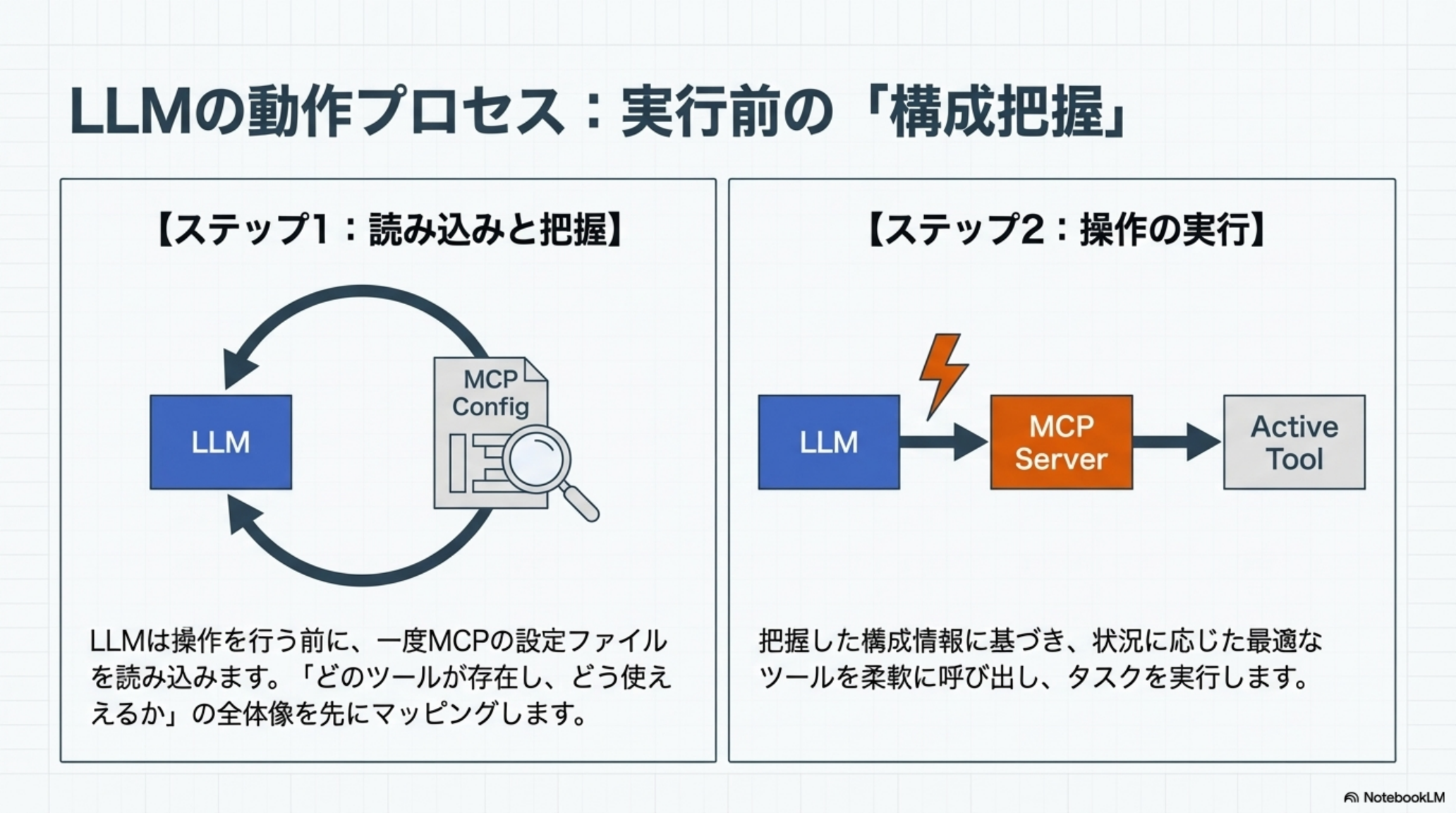

LLMの動作プロセス:実行前の「構成把握」

MCPのユニークな点は、LLMがツールを使う前にまず全体像を把握するステップがあることです。これは2段階で行われます。

ステップ1: 読み込みと把握

LLMは操作を行う前に、まずMCPの設定ファイルを読み込みます。「どのツールが存在し、どう使えるか」の全体像を先にマッピングします。

ステップ2: 操作の実行

把握した構成情報に基づき、状況に応じた最適なツールを柔軟に呼び出し、タスクを実行します。

レストランに入ったとき、まずメニューを見てから注文しますよね? MCPも同じです。LLMは「メニュー(設定ファイル)」を先に確認して、「今使えるツール一覧」を頭に入れてから、必要なツールを注文します。

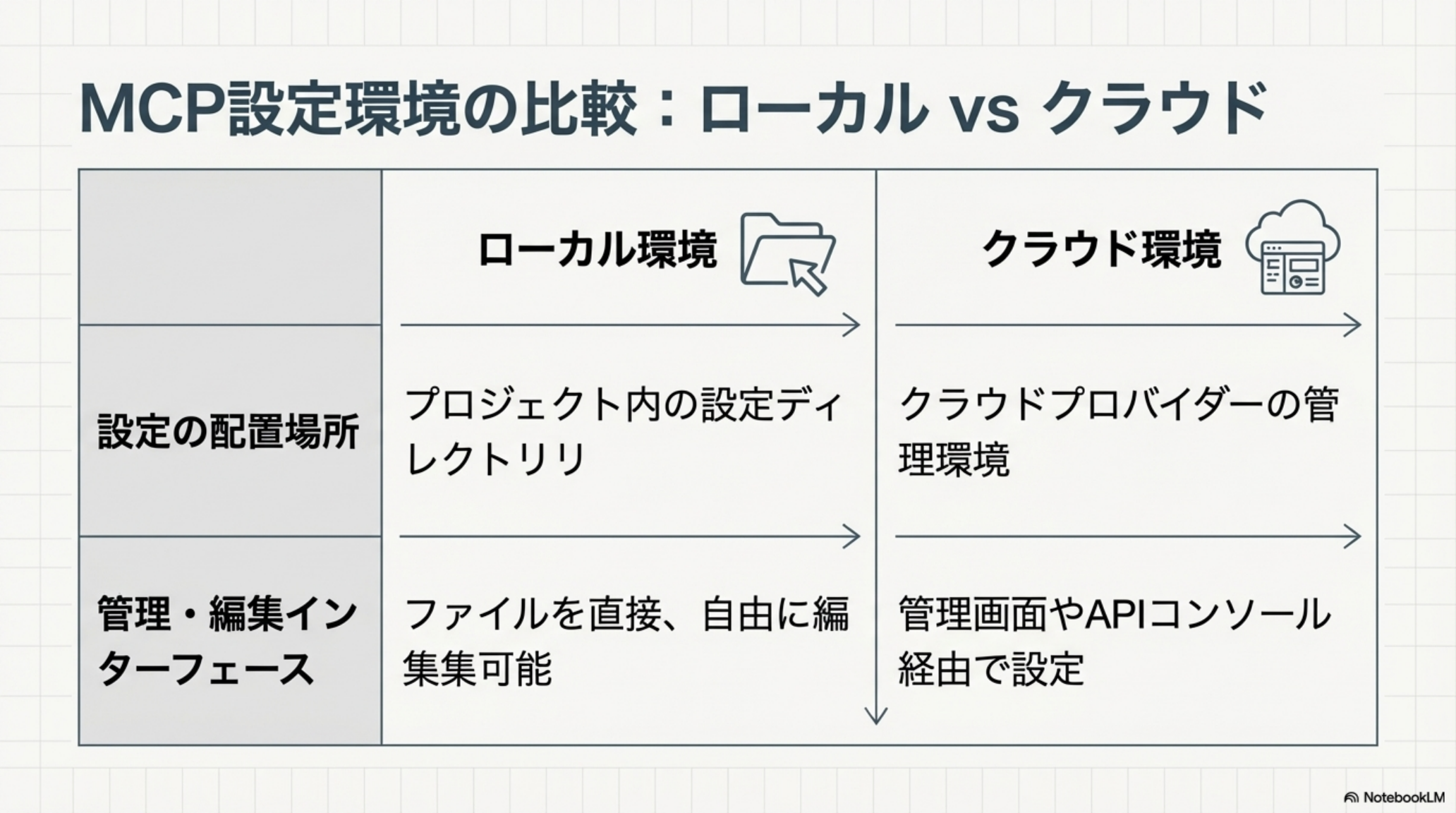

MCP設定環境の比較:ローカル vs クラウド

MCPの設定は、ローカル環境とクラウド環境の2つの方法で管理できます。

| 項目 | ローカル環境 | クラウド環境 |

|---|---|---|

| 設定の配置場所 | プロジェクト内の設定ディレクトリ | クラウドプロバイダーの管理環境 |

| 管理・編集インターフェース | ファイルを直接、自由に編集可能 | 管理画面やAPIコンソール経由で設定 |

| 向いている人 | 開発者、カスタマイズしたい人 | すぐに使いたい人、管理を任せたい人 |

| 柔軟性 | 高い(完全にカスタマイズ可能) | 中程度(プロバイダーの仕様に依存) |

最初はクラウド環境から始めるのがおすすめです。設定の手間が少なく、すぐに試せます。慣れてきたらローカル環境に移行して、細かくカスタマイズしましょう。

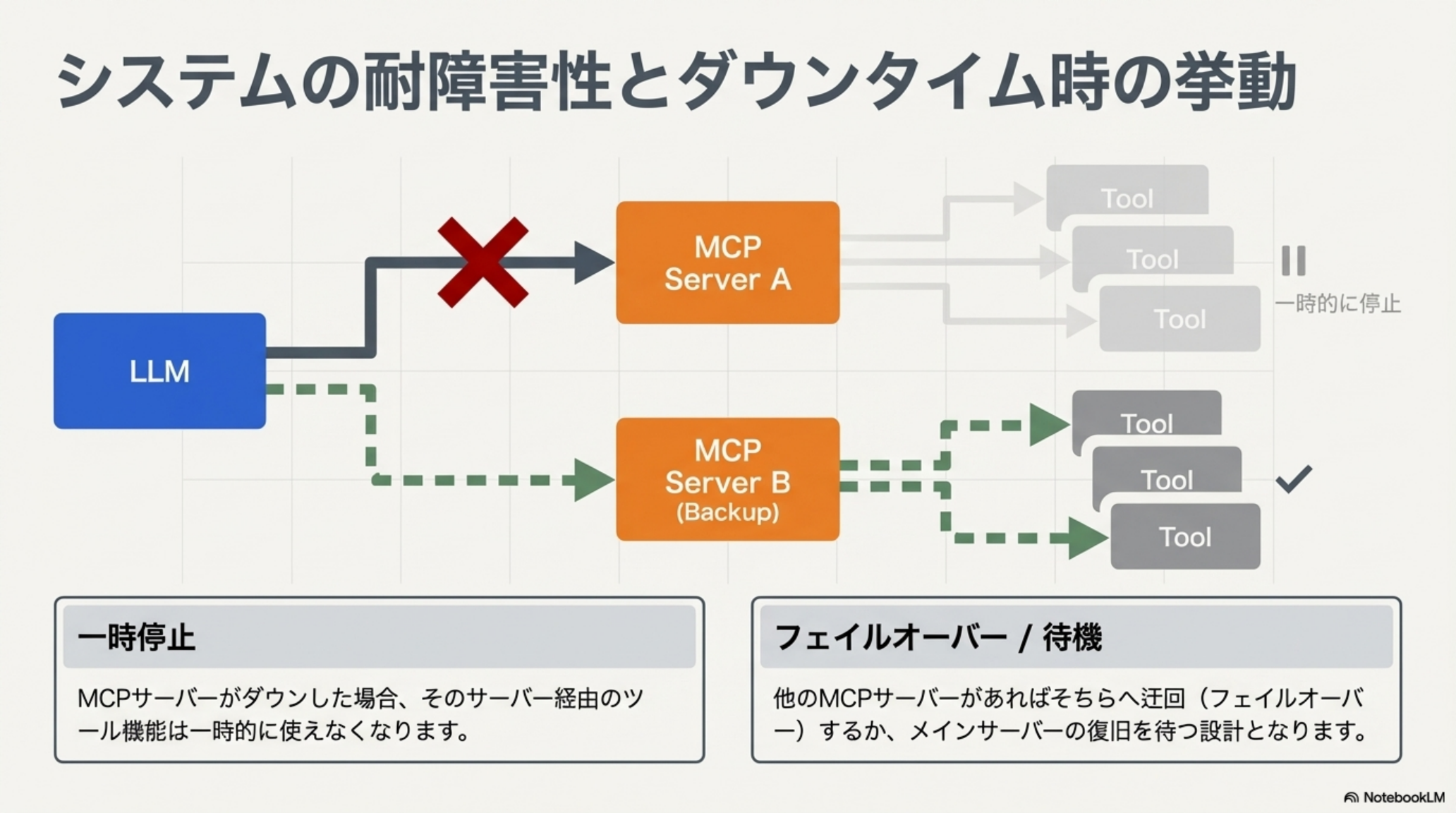

システムの耐障害性とダウンタイム時の挙動

MCPサーバーを使うシステムでは、「もしMCPサーバーが止まったらどうなるの?」という疑問が当然出てきます。これに対する設計がフェイルオーバーです。

一時停止

MCPサーバーがダウンした場合、そのサーバー経由のツール機能は一時的に使えなくなります。

フェイルオーバー / 待機

他のMCPサーバーがあればそちらへ迂回(フェイルオーバー)するか、メインサーバーの復旧を待つ設計となります。

MCPサーバーへの依存度が高いシステムでは、必ずバックアップサーバーを用意しましょう。本番環境では「単一障害点(Single Point of Failure)」を作らないことが鉄則です。

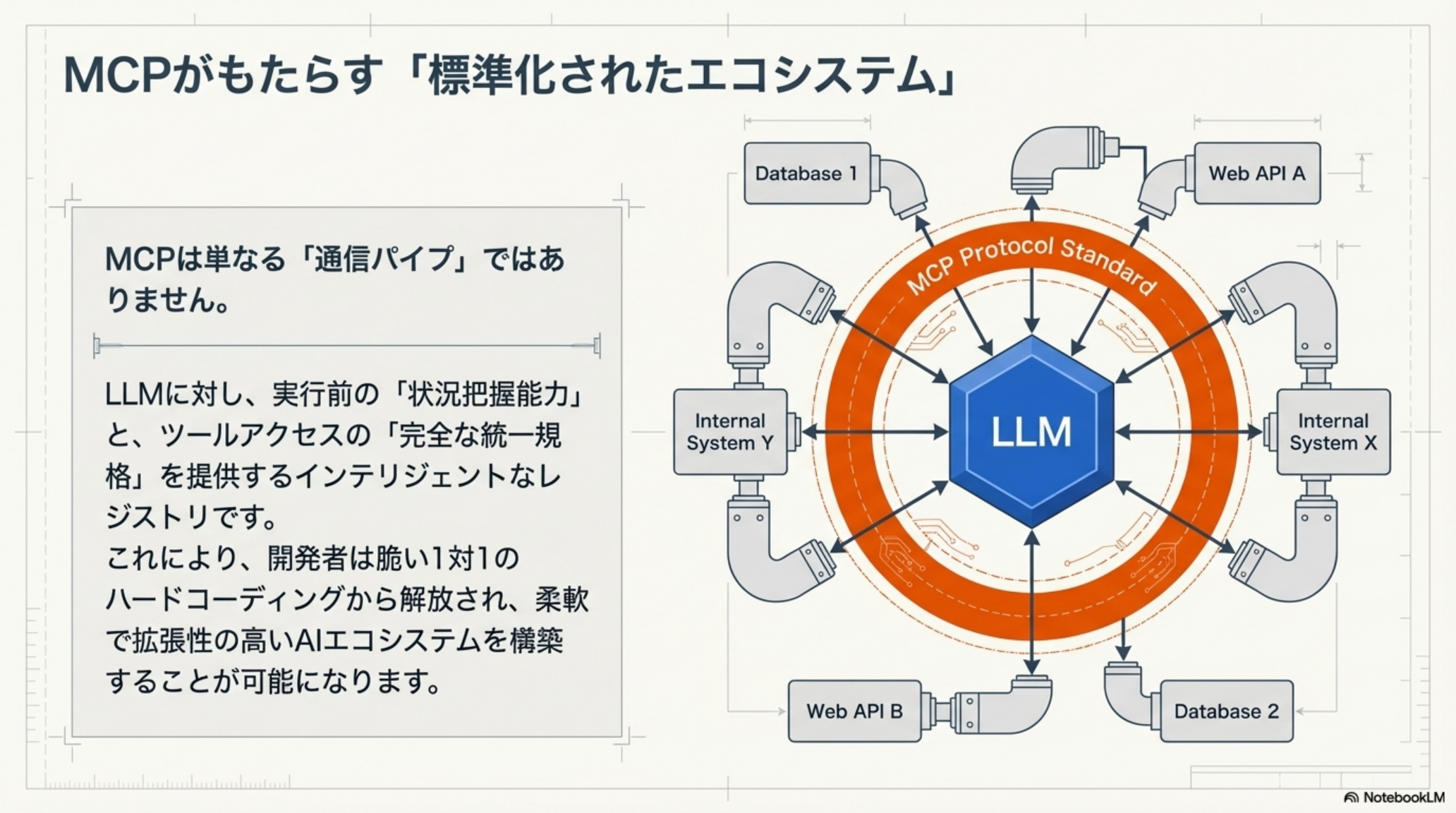

MCPがもたらす「標準化されたエコシステム」

MCPは単なる「通信パイプ」ではありません。LLMに対し、実行前の「状況把握能力」と、ツールアクセスの「完全な統一規格」を提供するインテリジェントなレジストリです。

これにより、開発者は脆い1対1のハードコーディングから解放され、柔軟で拡張性の高いAIエコシステムを構築することが可能になります。

- 標準化:どのツールも同じ方法で接続できる

- 構成把握:LLMが使える前にツール一覧を理解する

- 拡張性:新しいツールの追加が簡単

- 耐障害性:フェイルオーバー設計で安定稼働

- エコシステム:開発者コミュニティが共通規格で成長

MCPの今後の可能性

MCPのような標準プロトコルが普及すると、AIツールの世界に「USB規格」のような革命が起きます。昔はプリンター、マウス、キーボードそれぞれ別の端子が必要でしたが、USBですべて統一されました。MCPはAIの世界で同じ役割を果たしています。

今後、より多くのツールやサービスがMCPに対応していくことで、LLMの活用範囲は飛躍的に広がっていくでしょう。